티스토리 뷰

목차

감정 인식 기술은 얼굴 표정, 근육 움직임, 눈동자 등 비언어적 신호를 분석해 감정 상태를 추정하는 방식으로,

정확성과 윤리성에 대한 논의가 함께 이루어지고 있습니다.

“기분이 안 좋아 보이시네요?” 이젠 사람이 아니라 AI가 말합니다

누군가 내 표정을 보며

“오늘 기분 안 좋아 보여요”라고 말한다면

그건 대부분 나를 오래 본 사람일 확률이 높습니다.

하지만 지금은 다릅니다.

카메라와 인공지능이 내 얼굴을 보며, 내 감정을 추정하는 시대

바로 페이스테크(Face Tech)와 감정 인식 기술의 결합이 현실이 되고 있죠.

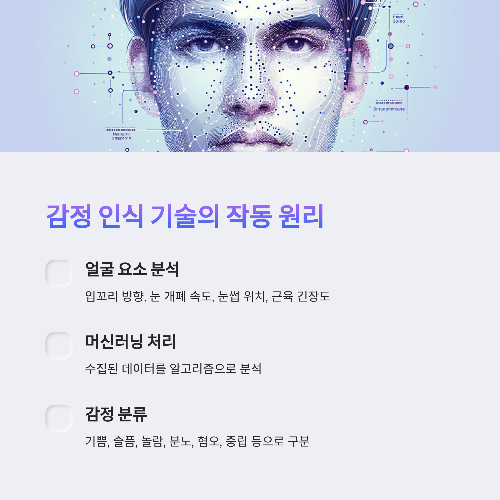

감정 인식 기술, 어떻게 작동할까?

감정 인식은 단순히 ‘웃고 있다 = 기쁨’이 아닙니다.

다양한 얼굴 요소들을 종합적으로 분석해 작동합니다.

분석 요소

- 입꼬리의 방향과 각도

- 눈의 개폐 속도

- 눈썹의 위치와 대칭

- 얼굴 근육의 긴장도

- 얼굴 전체 표정 변화 속도

이 데이터를 머신러닝 알고리즘이 분석하여

기쁨, 슬픔, 놀람, 분노, 혐오, 중립 같은 기본 감정으로 분류합니다.

어디에 활용되고 있을까?

“1. 광고와 마케팅”

광고를 보는 소비자의 표정을 인식해

어떤 장면에서 관심을 보였는지, 지루해했는지 측정

→ 광고 개선, 개인 맞춤 콘텐츠 설계

“2. 교육”

학생의 수업 중 집중도, 피로도, 흥미도를 실시간 분석

→ AI 튜터링 시스템에서 학습 피드백 자료로 활용

“3. 고객 응대 및 서비스”

콜센터나 키오스크에서

표정 기반 응대 전략 변화

→ 예: 무표정이면 밝은 멘트, 웃고 있으면 빠른 안내

“4. 보안 및 공공안전”

공항, 지하철 등에서

수상한 표정, 긴장된 행동을 인식해 실시간 모니터링

진짜 감정, AI가 읽을 수 있을까?

“1. 표정 = 감정이 아니다”

사람은 기쁘지 않아도 웃을 수 있고,

슬퍼도 웃을 수 있으며,

화나도 무표정을 유지할 수 있습니다.

즉, 표정은 감정의 단서일 뿐, 감정 자체는 아니라는 점

이건 인간도 놓치기 쉬운 부분이죠.

“2. 문화와 개인차의 한계”

- 같은 감정도 나라, 문화, 성격, 습관에 따라 표현 방식이 다릅니다.

- 예: 일본인은 공공장소에서 감정을 얼굴로 잘 드러내지 않음

이로 인해

AI가 학습한 데이터셋에 따라 편향된 감정 분석 결과가 나올 수 있어요.

“3. 기술 오인식 가능성 여전”

- 조명, 카메라 각도, 화질 등 외부 환경에 영향을 많이 받음

- 얼굴 마비, 표정 장애, 성형 등으로 일반적 표정 분석이 어려운 사례 존재

이런 조건에서는

잘못된 감정 분류가 오히려 문제를 일으킬 수 있습니다.

윤리적으로도 살펴봐야 할 문제

“1. 비동의 감정 분석?”

내가 동의하지 않았는데

내 얼굴 표정이 실시간으로 분석되고 있다면?

이는 심각한 사생활 침해가 될 수 있습니다.

특히 공공장소, 매장, 수업 중 무단 감정 분석은

‘감시 사회’의 일환으로 받아들여질 수 있어요.

“2. 감정을 점수화하는 사회?”

감정 분석 결과가 성적, 평가, 추천 시스템에 들어간다면

우리는 ‘감정도 관리해야 하는 시대’를 살게 되는 것이죠.

이는 심리적 피로, 스트레스, 위축감을 유발할 수 있습니다.

그럼에도 불구하고 기대되는 긍정적 가능성

- 정서적 위험 조기 감지 (우울증, 번아웃 등)

- 맞춤형 서비스 최적화

- 고객 피드백 자동 수집

단, 이 모든 것은 “자발적 동의 + 정확도 보장 + 데이터 보안”이라는 조건 아래 이루어져야만 의미가 있습니다.

결론: AI는 감정을 읽을 수 있지만, 마음을 이해하진 못한다

페이스테크와 감정 인식 기술은

우리 삶을 더 편리하고 맞춤화된 방향으로 이끌 수 있습니다.

하지만 그 기술이

진짜 ‘마음’을 이해하지는 못합니다.

감정은 표정만으로 판단할 수 없고,

진짜 마음은 여전히 사람만이 읽을 수 있는 영역이니까요.

여러분은 어떻게 생각하시나요?

감정 인식 기술, 어디까지 허용되고 어디까지 조심해야 할까요?